环境准备:4台机器

192.168.217.174 node1 -----namenode

192.168.217.175 node2 -----secondary namenode

192.168.217.176 node3 -----datanode

192.168.217.177 node4 -----datanode

1. 4台机器免密码登录

1.1-先在node1机器上做免密码

在每天机器vim /etc/hosts中互相添加对方的ip和机器名

192.168.217.174 node1

192.168.217.175 node2

192.168.217.176 node3

192.168.217.177 node4

#ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa 1. 注:生成密钥

#cat ~/.ssh/id_dsa.pub >>~/.ssh/authorized_keys 2.注:密钥写入认证机制

1.2-其他3台机器做免密码

把在node1机器生成的公钥拷贝到其他3台机器,最后在放入每天机器的认证机制

#scp ./id_dsa.pub root@node(2,3,4):/opt/ #在node1上操作

#ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa #3台机器都执行这条命令

#cat/opt/id_dsa.pub >> ~/.ssh/authorized_keys #3台机器都执行这条命令

拷贝遇到问题:

bash: scp:command not found #yum install openssh-clients 4台都装

2.开始安装

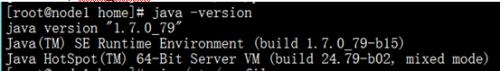

2.1-安装JDK:------------4台都安装

#上传jdk-7u79-linux-x64.rpm到/home目录

#rpm –ivh jdk-7u79-linux-x64.rpm

#cd /home/hadoop-2.5.1

# vim~/.bash_profile 添加环境变量

export PATH

export JAVA_HOME=/usr/java/jdk1.7.0_79

exportPATH=$PATH:$JAVA_HOME/bin

exportHADOOP_HOME=/home/hadoop-2.5.1

exportPATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

# source ~/.bash_profile

2.2-安装hadoop

#上传hadoop-2.5.1_x64.tar.gz到/home目录 【在node1操作】

#tar zxvfhadoop-2.5.1_x64.tar.gz

#vim /home/hadoop-2.5.1/etc/hadoop/hadoop-env.sh #namenode主机名

exportJAVA_HOME=/usr/java/jdk1.7.0_79/ (添加)

#vim /home/hadoop-2.5.1/etc/hadoop/core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://node1:9000</value> # namenode数据上传的主机及端口

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop-2.5</value> # 保存的路径

</property>

</configuration>

#vim /home/hadoop-2.5.1/etc/hadoop/hdfs-site.xml

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>node2:50090</value> #secondary namenode

</property>

<property>

<name>dfs.namenode.secondary.https-address</name>

<value>node2:50091</value>

</property>

</configuration>

#vim /home/hadoop-2.5.1/etc/hadoop/slaves # 配置datanode主机名

node2

node3

node4

#vim masters # 创建配置secondary namenode主机名

node2

#rm -rf hadoop-2.5.1/share/doc/ 删除这个目录方便拷贝给其他机器

2.3-拷贝给其他机器

在/home目录下

#scp -r hadoop-2.5.1 root@node(234):/home/

在/home/hadoop-2.5.1

# scp~/.bash_profile root@node(234):/root/

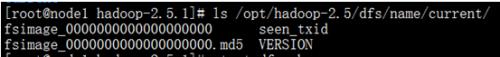

启动之前先格式化hdfs文件系统

# hdfs namenode-format 只能在指定的namenode(node1)机器上用

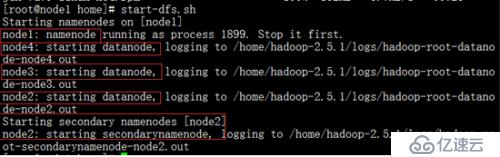

#start-dfs.sh 在任何目录下都可以启动

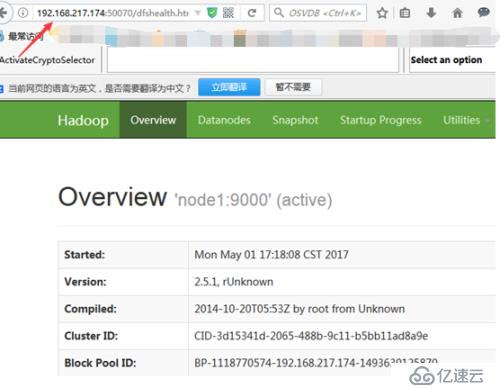

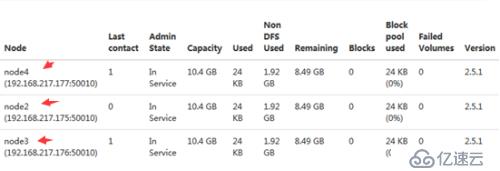

浏览器访问:192.168.217.174:50070

(如果不能打开,就关闭防火墙# serviceiptables stop)

到此,hadoop集群安装完毕

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。