这篇文章将为大家详细讲解有关Spark RDD的内容有哪些,文章内容质量较高,因此小编分享给大家做个参考,希望大家阅读完这篇文章后对相关知识有一定的了解。

点击步骤:

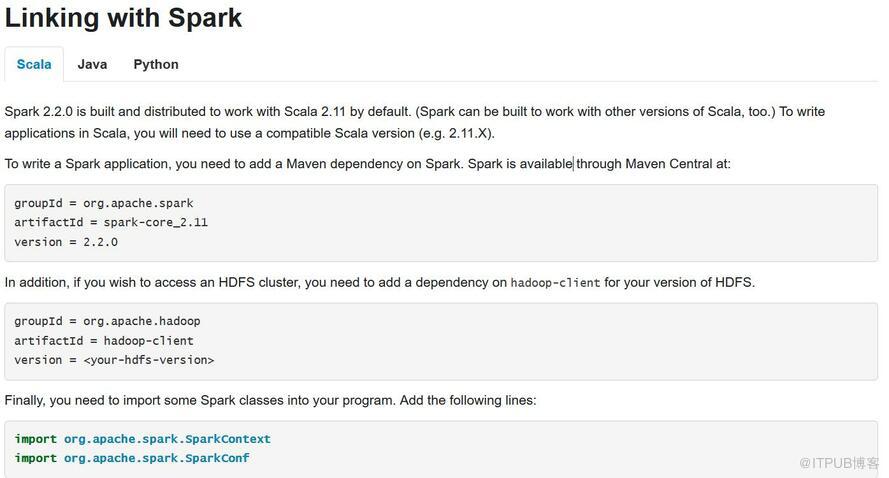

Spark Programming Guide

Linking with Spark

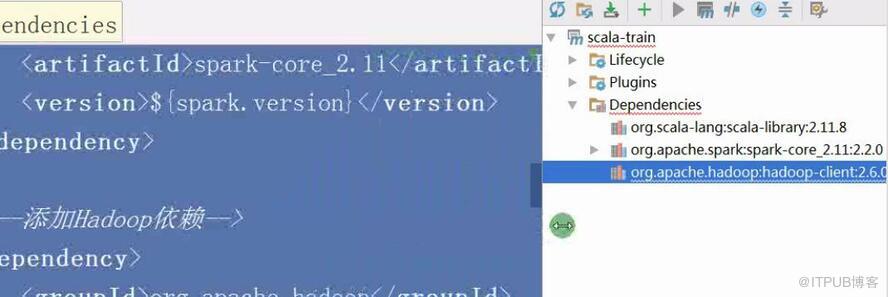

版本要对应和集群上

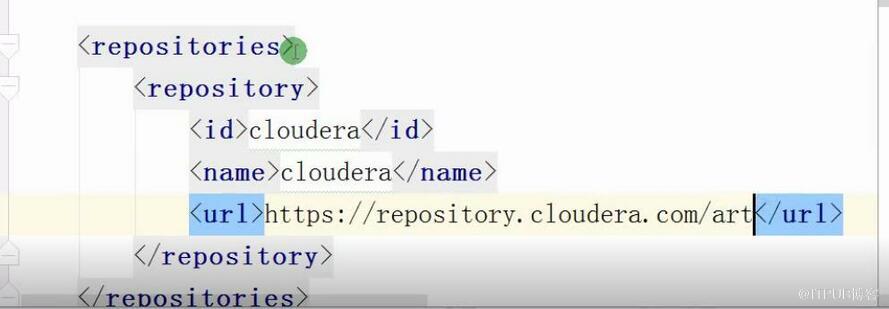

idea 引入cdh版的hadoop等包可能报红线, 因为默认idea引的仓库是apache的所以有红线

公司中是用rz ftp工具不用因为中间有跳板机,ftp不好用

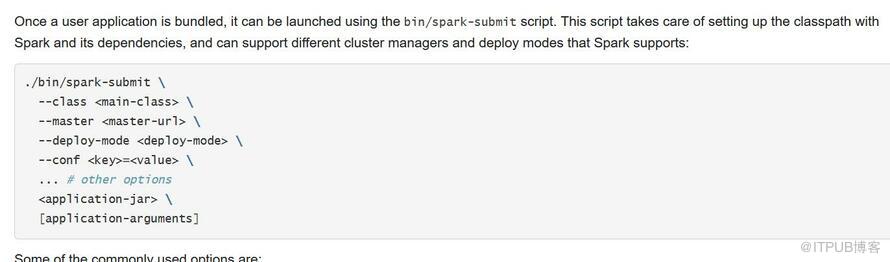

spark-submit \

--class test.Demo2 \

--master local[2] \

/demo/original-sparkrdd-1.0-SNAPSHOT.jar \

hdfs://s202:9000/input/* \

hdfs://s202:9000/result

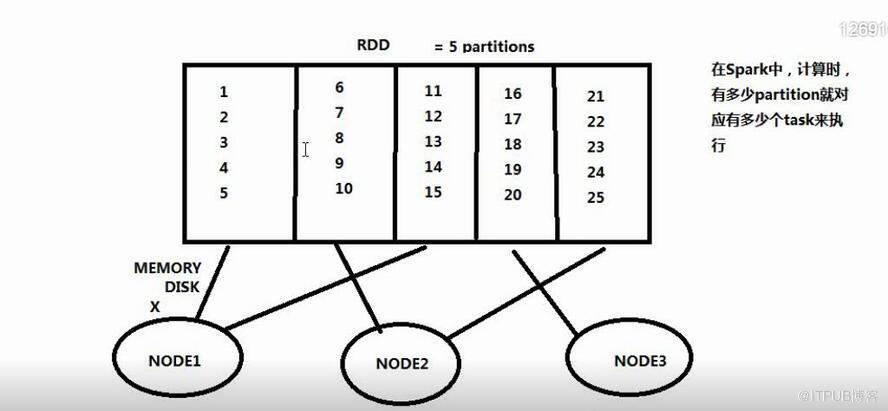

弹性分布式数据集 弹性体现在计算上,分布式的时候计算可以容错,通过机制进行修复,准确是体现在计算层面上

* - A list of partitions

* - A function for computing each split

每个函数作用每个分区上

对RDD计算就是对分区进行计算

split 如分区partitions

* - A list of dependencies on other RDDs

RDDA 是加载其余是转化的

RDDA-RDDB-RDDC

* - Optionally, a Partitioner for key-value RDDs (e.g. to say that the RDD is hash-partitioned)

优化时候用的多

* - Optionally, a list of preferred locations to compute each split on (e.g. block locations for

* an HDFS file)

preferred locations(类似多个副本) 数组在哪在那计算性能好,不用移动数据

对每个分片计算会有一组

计算每个分片会有多个副本

窄依赖容错不是对所有分区进行重新计算,对父类,宽依赖不通

Resilient Distributed Dataset (RDD)在上面五个特点完美体现

切分,副本,计算,分布式关键计算传什么参数,对应第二个特点,必须传个分片的

def compute(split: Partition, context: TaskContext): Iterator[T]

对应RDD第一点

protected def getPartitions: Array[Partition]

对应第三点

protected def getDependencies: Seq[Dependency[_]] = deps

计算必须拿到PreferredLocations 在什么位置

第五点

protected def getPreferredLocations(split: Partition): Seq[String] = Nil

对应第四点

@transient val partitioner: Option[Partitioner] = None

类似于JdbcRDD什么都要继承RDD

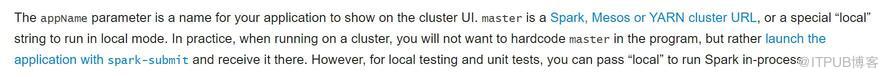

appName 是一个作业的名字

也可以不写,不要硬编码,提交时写,用时间拼接,可以知道提交的是哪个

The appName parameter is a name for your application to show on the cluster UI.

master 是你连接集群的方式

master is a Spark, Mesos or YARN cluster URL, or a special “local” string to run in local mode.

但是,运行一个集群你不要硬编码,不要代码中设置master,提交的时候设置

In practice, when running on a cluster, you will not want to hardcode master in the program,

而是要用spark-submit 提交,

but rather launch the application with spark-submit and receive it there.

测试就用local 就可以了

However, for local testing and unit tests, you can pass “local” to run Spark in-process.Only one SparkContext may be active per JVM. You must stop() the active SparkContext before creating a new one.

一个jvm只能有一个SparkContext,想要在启动别个,必须关闭stop()在spark-env 中配置HADOOP_CONF_DIR or YARN_CONF_DIR ,指向hadoop的etc/hadoop的

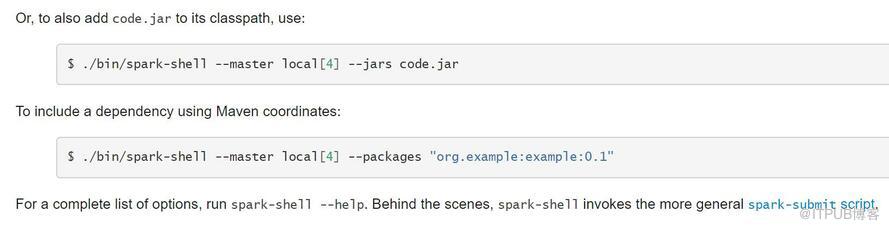

spark-shell 底层也是调用spark-submit 脚本运行

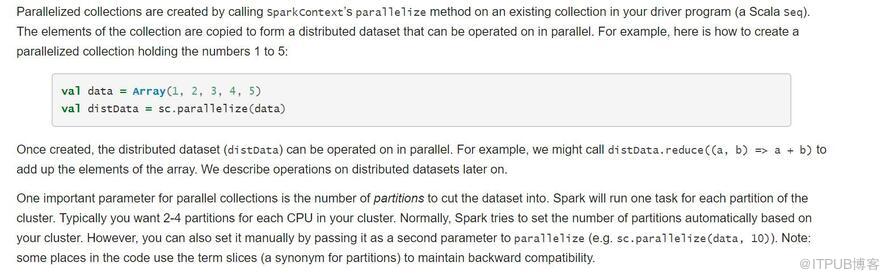

Typically you want 2-4 partitions for each CPU in your cluster. 不浪费

因为这样设置省着cpu空闲,一个分区一个CPU可能空闲,浪费

task多不处理小文件多,要合并,调优

加载外部集合用parallelize方法,用的少,最好有个CPU对应几个分区, 防止空闲浪费资源,一个task一个分区

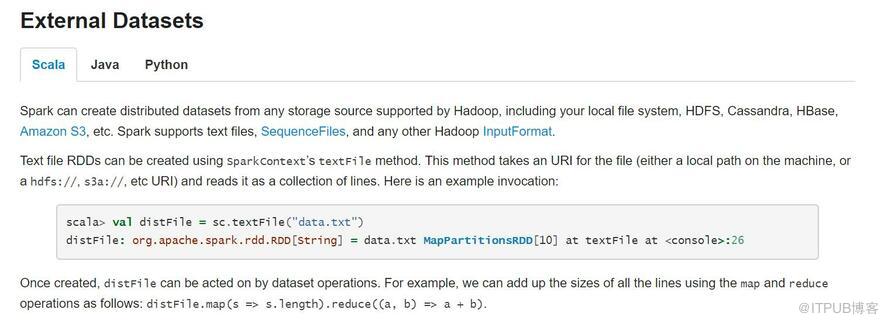

加载外部数据源,本地文件,HDFS,hbase等

1.如果你要使用本地文件,那你又多少个节点,每个节点都要有这个文件,否则

找不到,standalone 也一样,一般用不到

2.全部的输入方式包括文件,支持目录,压缩,通配符

3.textFile() 有第二个参数,分区,默认有个block一个分区,你可以调的

更高,不可以比block更少

这个可以调优

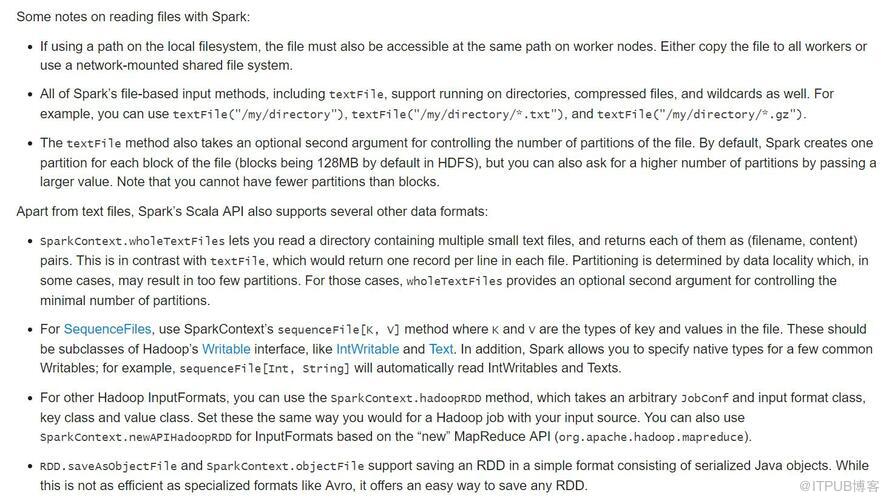

1.wholeTextFiles() 返回key,value key是路径,value值

2序列化测试

3.saveAsTextFile() 保存关于Spark RDD的内容有哪些就分享到这里了,希望以上内容可以对大家有一定的帮助,可以学到更多知识。如果觉得文章不错,可以把它分享出去让更多的人看到。

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

原文链接:http://blog.itpub.net/69941978/viewspace-2651837/