在人工智能领域中的图像分类问题上,最常用来训练和测试的数据集是 ImageNet,它也是全球最大的“CV 习题库”。近日,麻省理工学院和 IBM 研究人员组成的团队,共同创建了一个与之不同的图像识别数据集 ObjectNet,难倒了世界上最好的计算机视觉模型。

需要提示的是,这里的最好或最强指的不是某一个模型,而是一类高性能的视觉模型。

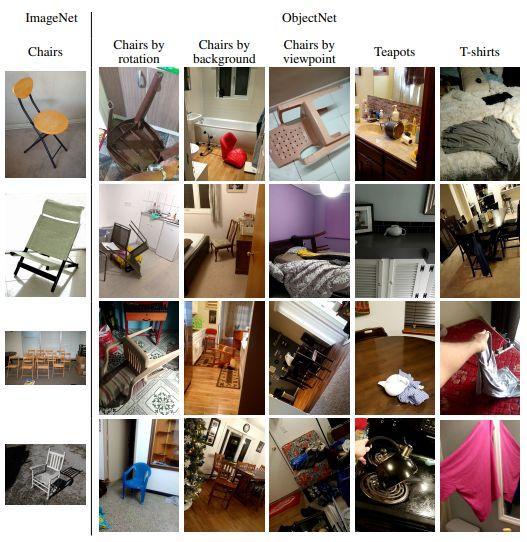

在 ImageNet 测试中实现准确率高达 97% 的计算机视觉模型,在 ObjectNet 数据集上检测的准确率下降到了 50%-55%。测试结果如此“惨烈”,主要原因在于,目前几乎所有的视觉模型,在类似于物体旋转、背景变换、视角切换等复杂情境下,识别过程都缺乏稳定性。

麻省理工学院计算机科学与人工智能实验室 (CSAIL) 和大脑、心智与机器中心 (CBMM) 的研究科学家 Andrei Barbu,是该研究的通讯作者,也是该项目的主持人之一。他在接受 DeepTech 专访时表示,“我们需要一个数据集能够具有典型意义地表示你在现实生活中看到的东西,没有这个东西,谁还有信心做计算机视觉?我们怎么能说计算机视觉已经为黄金时代和关乎安全的关键应用做好了准备?”

Andrei Barbu 还表示,ObjectNet 可以向全球研究者分享,“只要联系我们,我们将发送给你。”(网站: https://objectnet.dev/ )

图 | ImageNet(来源:ImageNet)

图 | ImageNet(来源:ImageNet)

人工智能使用由神经元层组成的神经网络在大量的原始数据中寻找规律。比如,在看过成百上千张椅子的照片之后,它学会了椅子的形状。

斯坦福大学每年都会举行一个比赛,邀请谷歌、微软、百度等 IT 企业使用 ImageNet 测试他们的系统运行情况。每年一度的比赛也牵动着各大巨头公司的心弦。

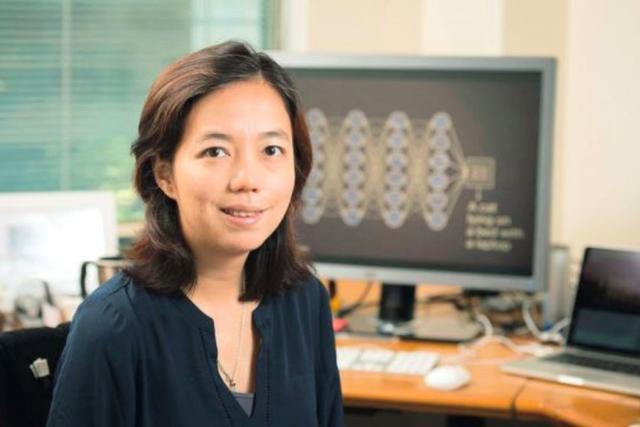

ImageNet 由世界上顶尖的计算机视觉专家李飞飞参与建立,她在一次演讲中提到,要让冰冷的机器读懂照片背后的故事,就需要让机器像婴儿一样看过足够多的“训练图像”。

ImageNet 从 Flickr 和其他社交媒体网站上下载了接近 10 亿张图片,2009 年,ImageNet 项目诞生了,含有近 1500 万张照片的数据库, 涵盖了 22000 种物品。

计算机视觉模型已经学会了精确地识别照片中的物体,以至于有些模型在某些数据集上表现得比人类还要好。

图 | ImageNet 创建者之一李飞飞(来源:Wikipedia)

图 | ImageNet 创建者之一李飞飞(来源:Wikipedia)

但是,当这些模型真正进入到生活中时,它们的性能会显著下降,这就给自动驾驶汽车和其他使用计算机视觉的关键系统带来了安全隐患。

因为即使有成百上千张照片,也无法完全显示物体在现实生活中可能摆出的方向和位置。椅子可以是倒在地上的,T 恤可能被挂在树枝上,云可以倒映在车身上…… 这时候识别模型就会产生疑惑。

AI 公司 Vicarious 的联合创始人 Dileep George 曾表示:“这表明我们在 ImageNet 上花费了大量资源来进行过拟合。”过度拟合是指过于紧密或精确地匹配特定数据集的结果,以致于无法拟合其他数据或预测未来的观察结果。

与 ImageNet 随意收集的照片不同,ObjectNet 上面提供的照片是有特殊背景和角度的,研究人员让自由职业者为数百个随机摆放的家具物品拍照,告诉他们从什么角度拍摄以及是摆在厨房、浴室还是客厅。

因此,数据集中的物品的拍摄角度非常清奇,侧翻在床上的椅子、浴室中倒扣的茶壶、 挂在客厅椅背上的 T 恤……

图 | ImageNet(左栏)经常显示典型背景上的对象,很少有旋转,也很少有其他视角。典型的 ObjectNet 对象是从多个视点在不同的背景上进行映像的。前三列显示了椅子的三个属性:旋转、背景和视角。可以看到由于这些操作而引入到数据集的大量变化。由于不一致的长宽比,此图只略微裁剪了 ObjectNet 图像。大多数检测器对 ObjectNet 中包含的大多数图像都识别失败了(来源:论文)

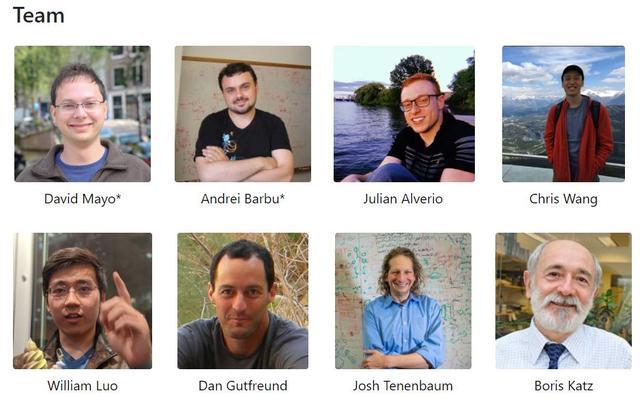

麻省理工学院 CSAIL 和 CBMM 的研究科学家 Boris Katz 说:“我们创建这个数据集是为了告诉人们,物体识别问题仍然是个难题。”“我们需要更好、更智能的算法。”

Katz 和他的同事将在正在召开的 NeurIPS 会议上展示他们的成果,NeurIPS 是人工智能和机器学习领域的国际顶级会议。

图 | ObjectNet 研究团队。这项研究由美国国家科学基金会,麻省理工学院大脑、心智和机器中心,麻省理工学院 - IBM 沃森人工智能实验室,丰田研究所和 SystemsThatLearn@CSAIL 倡议资助(来源:ObjectNet)

图 | ObjectNet 研究团队。这项研究由美国国家科学基金会,麻省理工学院大脑、心智和机器中心,麻省理工学院 - IBM 沃森人工智能实验室,丰田研究所和 SystemsThatLearn@CSAIL 倡议资助(来源:ObjectNet)

另外,ObjectNet 与传统图像数据集还有一个重要的区别:它不包含任何训练图像。也就是说,练习题和考试题重合的几率变小了,机器很难“作弊”。大多数数据集都分为训练集和测试集,但是训练集通常与测试集有细微的相似之处,实际上是让模型在测试中占了先机。

乍一看,ImageNet 有 1500 万张图片,似乎非常庞大。但是当去除掉训练集部分时,它的大小与 ObjectNet 相当,差不多有 5 万张照片。

“如果我们想知道算法在现实世界中的表现如何,我们应该在没有偏见的图像上测试它们,这些图像应该是它们从未见过的,”Andrei Barbu 说。

图 | 亚马逊的“土耳其机器人”Amazon Mechanical Turk(MTurk)是一种众包网络集市,能使计算机程序员调用人类智能来执行目前计算机尚不足以胜任的任务。ImageNet 和 ObjectNet 都通过这些平台来标记图片(来源:Amazon Mechanical Turk)

研究人员说,结果表明,机器仍然很难理解物体是三维的,物体也可以旋转和移动到新的环境中。“这些概念并没有被构建到现代对象探测器的架构中,”研究的合著者、IBM 的研究员 Dan Gutfreund 说。

模型在 ObjectNet 上的测试结果如此“惨烈”,并不是因为数据量不够,而是模型对类似于旋转、背景变换、视角切换等等的认知缺乏稳定性。研究人员是如何得出这个结论的呢?他们让模型先用 ObjectNet 的一半数据进行训练,然后再用另一半数据进行测试。在相同的数据集上进行训练和测试,通常可以提高性能,但是这次,模型只得到了轻微的改进,这表明模型没有完全理解对象在现实世界中是如何存在的。

所以,研究人员认为,即使设计一个更大版本的、包含更多视角和方向的 ObjectNet,也不一定能教会人工智能理解物体的存在。ObjectNet 的目标是激励研究人员提出下一波革命性的技术,就像最初推出的 ImageNet 挑战一样。他们下一步会继续探究为何人类在图像识别任务上具有良好的泛化能力和鲁棒性,并希望这一数据集能够成为检验图像识别模型泛化能力的评估方法。

“人们向这些物体检测器输入了大量数据,但回报却在递减,”Katz 说。“你不可能把一个物体的每一个角度和每一个可能存在的环境都拍出来。我们希望这个新的数据集能够在现实世界中催生出一个不会出现意外失败的、强大的计算机视觉系统。”

图 | Andrei Barbu 是麻省理工学院研究科学家,主要研究语言、视觉和机器人技术,同时还涉猎神经科学。(来源:MIT)

图 | Andrei Barbu 是麻省理工学院研究科学家,主要研究语言、视觉和机器人技术,同时还涉猎神经科学。(来源:MIT)

DeepTech 对该研究合作者、CSAIL 和 CBMM 的研究科学家 Andrei Barbu 进行了专访(以下为不改变原意的采访实录):

DeepTech:这个构思是在什么时候产生的,目的是什么?现在可以下载使用了吗?

Andrei Barbu:ObjectNet 是在大约 4 年前提出的。因为即使许多数据集 (如 ImageNet) 的准确率高达 95% 以上,但是在现实世界中的性能可能比你预期的要差得多。

我们的想法是将其他学科的优秀实验设计直接引入机器学习,比如物理学和心理学。我们需要一个数据集能够具有典型意义地表示你在现实生活中看到的东西,没有这个东西,谁还有信心做计算机视觉?我们怎么能说计算机视觉已经为黄金时代和关乎安全的关键应用做好了准备?

ObjectNet 已经可以使用了,只要联系我们,我们将发送给你。

DeepTech:收集实际数据用了多长时间?数据的有效性如何?

Andrei Barbu:我们花了大约 3 年的时间来弄清楚怎么做,花了大约 1 年的时间来收集数据。现在我们可以更快地收集另一个版本,时间跨度为几个月。

我们在土耳其机器人上收集大约 10 万张图片,其中大约一半我们保存了下来。许多照片都是在美国以外的地方拍摄的,因此,有些物体可能看起来很陌生。成熟的橙子是绿色的,香蕉有不同的大小,衣服有不同的形状和质地。

DeepTech:成本是多少?在收集数据时遇到了什么问题?

Andrei Barbu:在学术界,成本是复杂的。人力成本高于在土耳其机器人上的成本,单在土耳其机器人上的成本就很可观。

收集这些数据遇到很多问题。这个过程很复杂,因为它需要在不同的手机上运行;指令很复杂,我们花了一段时间才真正理解如何以一种稳定的方式解释这个任务;数据验证也很复杂,小问题几乎层出不穷。我们需要很多实验来学习如何有效地做到这一点。

DeepTech:ObjectNet 与 Imagenet 的区别和联系是什么?

Andrei Barbu:与 ImageNet 的不同之处在于:1、我们收集图像的方式可以控制偏差。我们告诉人们如何旋转物体,在什么背景中放置物体,以及在哪个角度拍照。在大多数的数据集中,图像背景的信息会导致机器不自觉的“欺骗”,它们会凭借对于厨房背景的了解来预测某个东西可能是平底锅。

2、这些照片不是从社交媒体上收集的,所以它们不是那种好看的照片,人们也不想分享。我们还确保收集来自印度、美国以及不同社会经济阶层的图像。我们还有损坏或破碎物体的图像。

3、没有训练集。

这在 10 年前并不是什么大问题,但我们的方法在发现模式方面是如此强大,以至于没有人能够识别,所以我们需要这些变化来避免简单地调整我们的模型,以适应来自相同数据集的训练和测试集之间的偏见。

DeepTech:没有训练集 会带来什么影响?

Andrei Barbu:由于没有训练集,所有的方法都需要泛化。他们需要在一个数据集上进行培训,并在 ObjectNet 上进行测试。这意味着他们利用偏差的可能性要小得多,而他们成为强大的目标探测器的可能性要大得多。我们想说服每个人,至少在机器学习的既定领域,收集训练集的小组应该与收集测试集的小组分开。

由于我们已经成为一个数据驱动的研究领域,我们需要改变收集数据的方法,以推动科学的发展。

DeepTech:3D 对象太复杂了,我认为它很难表示。比如如何去表示旋转的椅子?

Andrei Barbu:我不认为 3D 很复杂。

显然你和我对物体的三维形状有一定的认识,因为我们可以从新的角度想象物体。

我认为这也是计算机视觉的未来,ObjectNet 的设计就是在对这个存疑。它不关心你构建模型的基准,真正重要的是,它为你提供了一个更可靠的工具,用来检测你的模型是不是足够强。

DeepTech:你们接下来的研究计划是什么?

Andrei Barbu:我们正在使用 ObjectNet 来理解人类的视觉。对人类在大规模物体识别方面的研究还不多,还有很多空白需要填补。我们将向成千上万的在土耳其机器人上有短暂演示的人展示 ObjectNet,让人们了解人类处理图片的各个阶段。

这也将有助于回答一些我们现在还不太了解的关于人类视觉和物体探测器之间关系的基本问题,比如,物体探测器的行为是否就像人类只能很快地看到一个物体?我们的初步结果表明,情况并非如此,这些差异可以用来建造更好的探测器。

我们还在开发下一个版本的 ObjectNet,我认为它对于检测器来说会更加困难:带有部分遮挡的 ObjectNet。对象将被其他对象部分覆盖。我们和其他许多研究小组有理由怀疑探测器对有遮挡的物体的识别还不够稳定,但是还需要一个严肃的基准来刺激下一波的进展。

https://zhuanlan.zhihu.com/p/97000888

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。