本篇内容介绍了“如何通过Spark的IDE搭建并测试Spark开发环境”的有关知识,在实际案例的操作过程中,不少人都会遇到这样的困境,接下来就让小编带领大家学习一下如何处理这些情况吧!希望大家仔细阅读,能够学有所成!

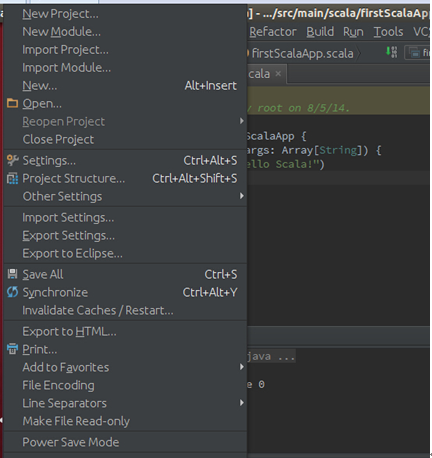

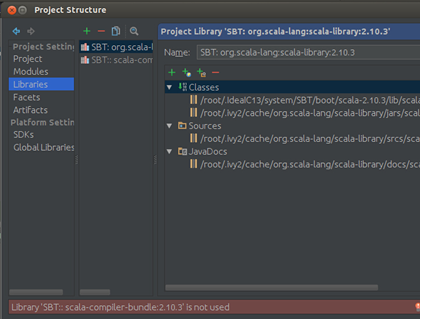

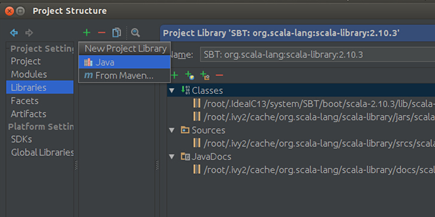

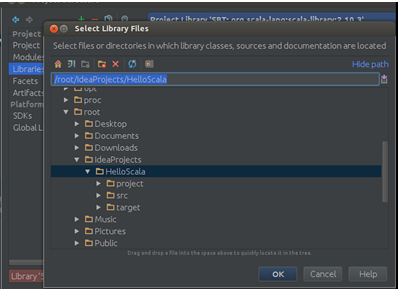

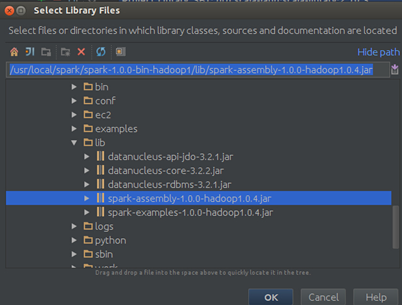

Step 1:导入Spark-hadoop对应的包,次选择“File”–> “Project Structure” –> “Libraries”,选择“+”,将spark-hadoop 对应的包导入:

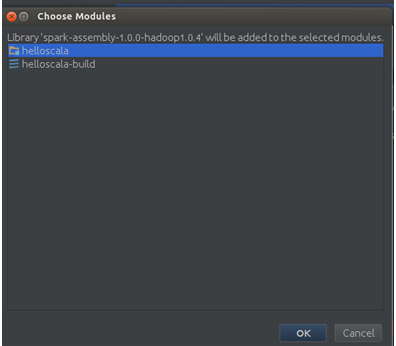

点击“OK”确认:

点击“OK”:

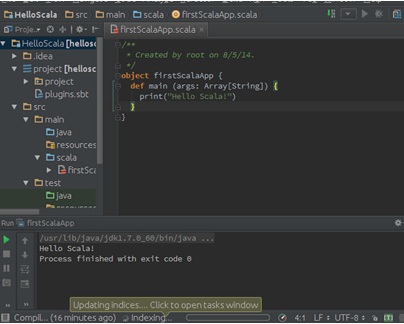

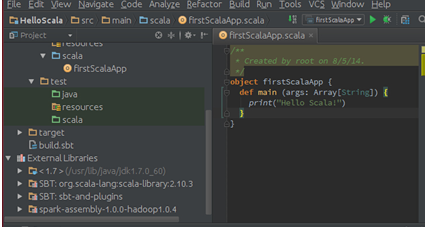

IDEA工作完成后会发现Spark的jar包导入到了我们的工程中:

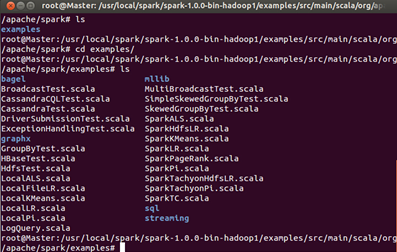

Step 2:开发第一个Spark程序。打开Spark自带的Examples目录:

此时发现内部有很多文件,这些都是Spark给我提供的实例。

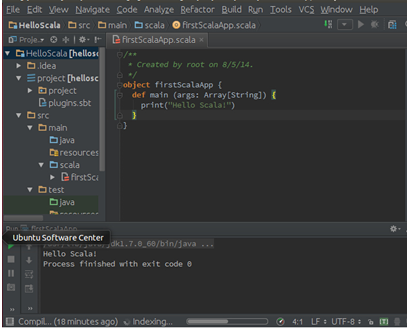

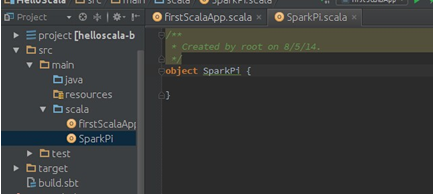

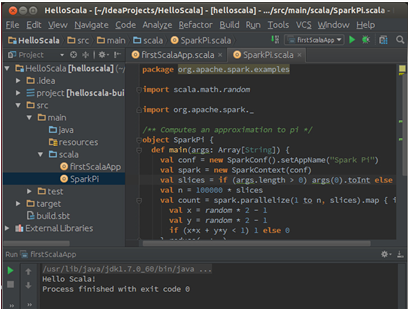

在我们的在我们的第一Scala工程的src下创建一个名称为SparkPi的Scala的object:

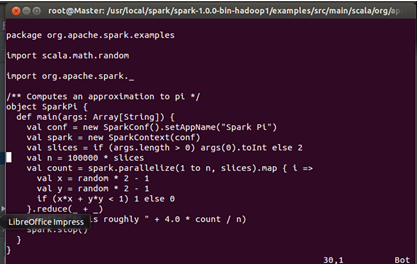

此时打开Spark自带的Examples下的SparkPi文件:

我们把该文的内容直接拷贝到IDEA中创建的SparkPi中:

“如何通过Spark的IDE搭建并测试Spark开发环境”的内容就介绍到这里了,感谢大家的阅读。如果想了解更多行业相关的知识可以关注亿速云网站,小编将为大家输出更多高质量的实用文章!

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

原文链接:https://my.oschina.net/u/1791057/blog/318518