本篇文章给大家分享的是有关Spark API编程中怎么以本地模式进行Spark API实战map、filter,小编觉得挺实用的,因此分享给大家学习,希望大家阅读完这篇文章后可以有所收获,话不多说,跟着小编一起来看看吧。

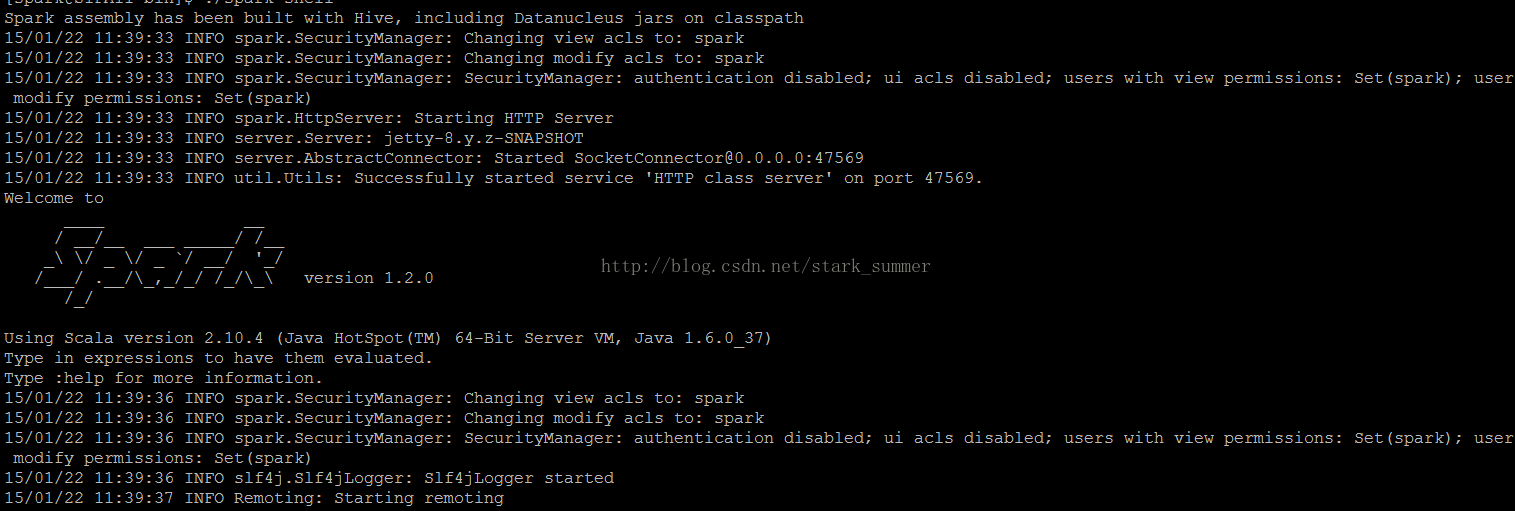

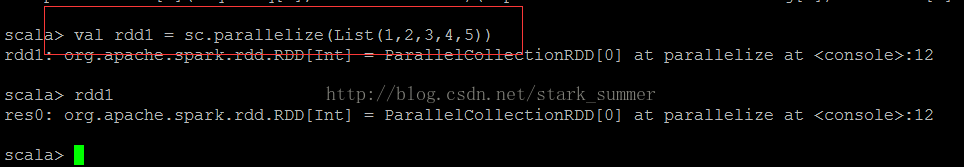

首先以spark的本地模式测试spark API,以local的方式运行spark-shell:

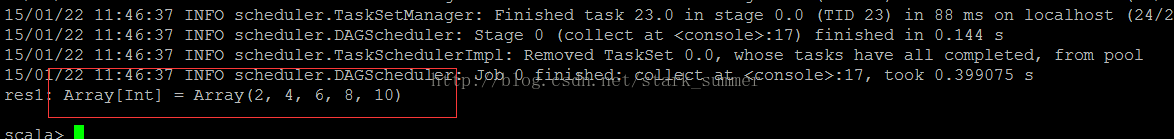

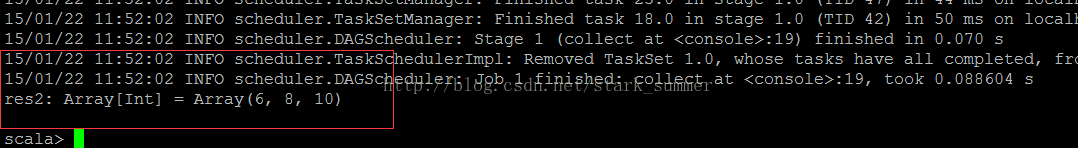

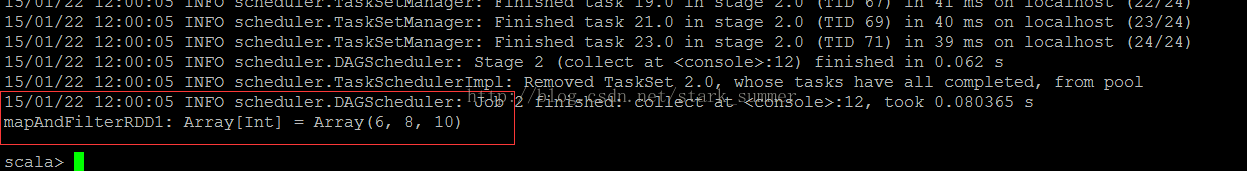

下面看下 filter操作:

我们用最正宗的scala函数式编程的风格:

从结果 可以看出来,与之前那种分步奏方式结果是一样的

但采用这种方式,即是复合scala风格的写法,也是符合spark的应用程序风格的写法,在spark的编程中,大多数功能的实现都是只要一行代码即可完成。

以上就是Spark API编程中怎么以本地模式进行Spark API实战map、filter,小编相信有部分知识点可能是我们日常工作会见到或用到的。希望你能通过这篇文章学到更多知识。更多详情敬请关注亿速云行业资讯频道。

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

原文链接:https://my.oschina.net/ghostmanyue/blog/372277