жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

иҝҷзҜҮж–Үз« е°ҶдёәеӨ§е®¶иҜҰз»Ҷи®Іи§Јжңүе…іpytorchдёӯеҰӮдҪ•и®Ўз®—дәӨеҸүзҶөжҚҹеӨұпјҢе°Ҹзј–и§үеҫ—жҢәе®һз”Ёзҡ„пјҢеӣ жӯӨеҲҶдә«з»ҷеӨ§е®¶еҒҡдёӘеҸӮиҖғпјҢеёҢжңӣеӨ§е®¶йҳ…иҜ»е®ҢиҝҷзҜҮж–Үз« еҗҺеҸҜд»ҘжңүжүҖ收иҺ·гҖӮ

е…¬ејҸ

йҰ–е…ҲйңҖиҰҒдәҶи§ЈCrossEntropyLossзҡ„и®Ўз®—иҝҮзЁӢпјҢдәӨеҸүзҶөзҡ„еҮҪж•°жҳҜиҝҷж ·зҡ„пјҡ

е…¶дёӯпјҢе…¶дёӯyiиЎЁзӨәзңҹе®һзҡ„еҲҶзұ»з»“жһңгҖӮиҝҷйҮҢеҸӘз»ҷеҮәе…¬ејҸпјҢе…ідәҺCrossEntropyLossзҡ„е…¶д»–иҜҰз»Ҷз»ҶиҠӮиҜ·еҸӮз…§е…¶д»–еҚҡж–ҮгҖӮ

жөӢиҜ•д»Јз ҒпјҲдёҖз»ҙпјү

import torch

import torch.nn as nn

import math

criterion = nn.CrossEntropyLoss()

output = torch.randn(1, 5, requires_grad=True)

label = torch.empty(1, dtype=torch.long).random_(5)

loss = criterion(output, label)

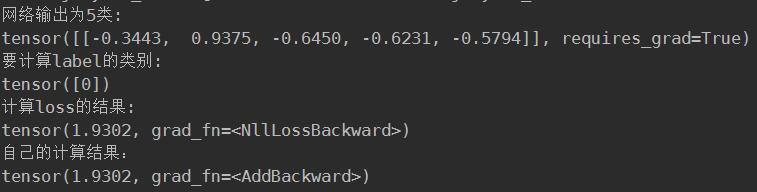

print("зҪ‘з»ңиҫ“еҮәдёә5зұ»:")

print(output)

print("иҰҒи®Ўз®—labelзҡ„зұ»еҲ«:")

print(label)

print("и®Ўз®—lossзҡ„з»“жһң:")

print(loss)

first = 0

for i in range(1):

first = -output[i][label[i]]

second = 0

for i in range(1):

for j in range(5):

second += math.exp(output[i][j])

res = 0

res = (first + math.log(second))

print("иҮӘе·ұзҡ„и®Ўз®—з»“жһңпјҡ")

print(res)

жөӢиҜ•д»Јз ҒпјҲеӨҡз»ҙпјү

import torch

import torch.nn as nn

import math

criterion = nn.CrossEntropyLoss()

output = torch.randn(3, 5, requires_grad=True)

label = torch.empty(3, dtype=torch.long).random_(5)

loss = criterion(output, label)

print("зҪ‘з»ңиҫ“еҮәдёә3дёӘ5зұ»:")

print(output)

print("иҰҒи®Ўз®—lossзҡ„зұ»еҲ«:")

print(label)

print("и®Ўз®—lossзҡ„з»“жһң:")

print(loss)

first = [0, 0, 0]

for i in range(3):

first[i] = -output[i][label[i]]

second = [0, 0, 0]

for i in range(3):

for j in range(5):

second[i] += math.exp(output[i][j])

res = 0

for i in range(3):

res += (first[i] + math.log(second[i]))

print("иҮӘе·ұзҡ„и®Ўз®—з»“жһңпјҡ")

print(res/3)

nn.CrossEntropyLoss()дёӯзҡ„и®Ўз®—ж–№жі•

жіЁж„ҸпјҡеңЁи®Ўз®—CrossEntropyLosssж—¶пјҢзңҹе®һзҡ„labelпјҲдёҖдёӘж ҮйҮҸпјүиў«еӨ„зҗҶжҲҗonehotзј–з Ғзҡ„еҪўејҸгҖӮ

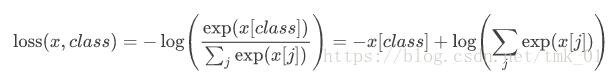

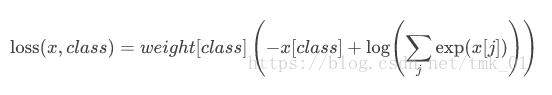

еңЁpytorchдёӯпјҢCrossEntropyLossи®Ўз®—е…¬ејҸдёәпјҡ

CrossEntropyLossеёҰжқғйҮҚзҡ„и®Ўз®—е…¬ејҸдёәпјҲй»ҳи®Өweight=Noneпјүпјҡ

е…ідәҺвҖңpytorchдёӯеҰӮдҪ•и®Ўз®—дәӨеҸүзҶөжҚҹеӨұвҖқиҝҷзҜҮж–Үз« е°ұеҲҶдә«еҲ°иҝҷйҮҢдәҶпјҢеёҢжңӣд»ҘдёҠеҶ…е®№еҸҜд»ҘеҜ№еӨ§е®¶жңүдёҖе®ҡзҡ„её®еҠ©пјҢдҪҝеҗ„дҪҚеҸҜд»ҘеӯҰеҲ°жӣҙеӨҡзҹҘиҜҶпјҢеҰӮжһңи§үеҫ—ж–Үз« дёҚй”ҷпјҢиҜ·жҠҠе®ғеҲҶдә«еҮәеҺ»и®©жӣҙеӨҡзҡ„дәәзңӢеҲ°гҖӮ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ