小编给大家分享一下python如何爬取某站上海租房图片,相信大部分人都还不怎么了解,因此分享这篇文章给大家参考一下,希望大家阅读完这篇文章后大有收获,下面让我们一起去了解一下吧!

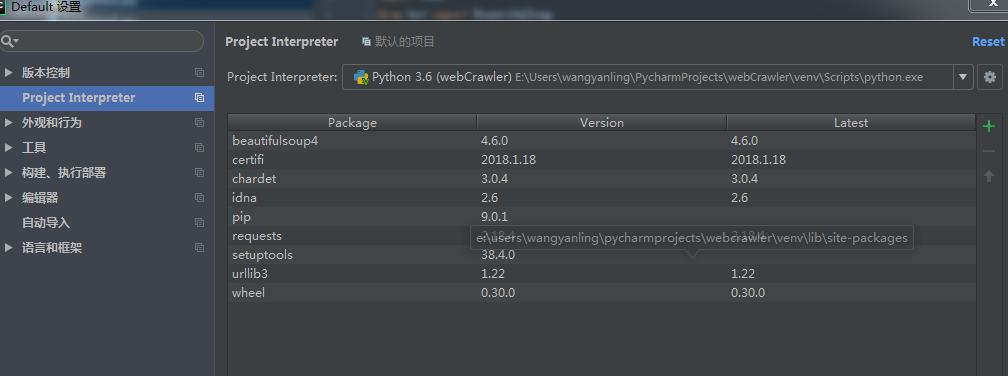

第三方库首先安装

我是用的pycharm所以另为的脚本安装我这就不介绍了。

如上图打开默认设置选择Project Interprecter,双击pip或者点击加号,搜索要安装的第三方库。其中如果建立的项目多记得Project Interprecter要选择正确的安装位置不然无法导入。

Requests库

requests库的官方定义:Requests 唯一的一个非转基因的 Python HTTP 库,人类可以安全享用。其实他就是请求网络获取网页数据的。

import requests

header={'User-Agent':'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 Safari/537.36'}

res=requests.get('http://sh.58.com/zufang/',headers=header)

try:

print(res.text);

except ConnectionError:

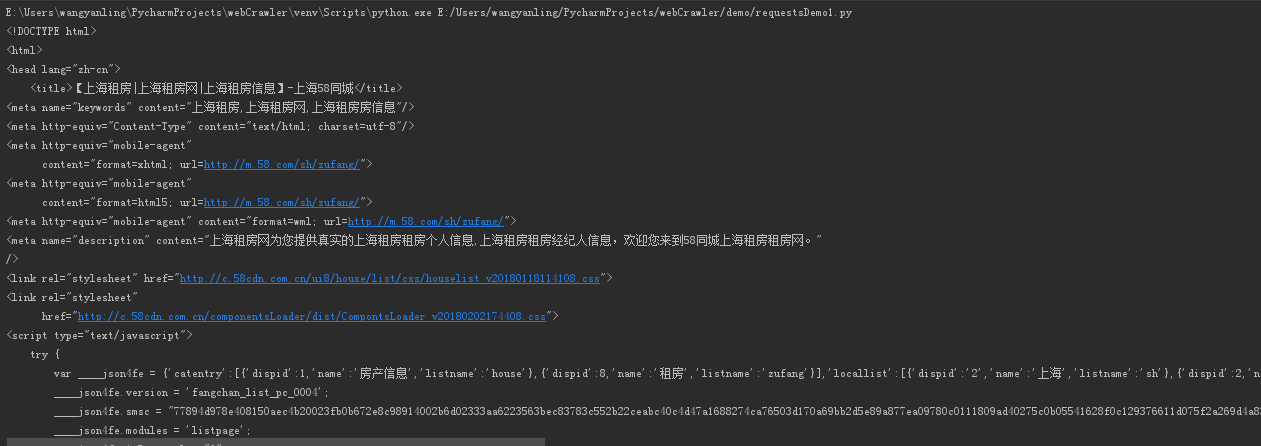

print('访问被拒绝!!!')结果如下:

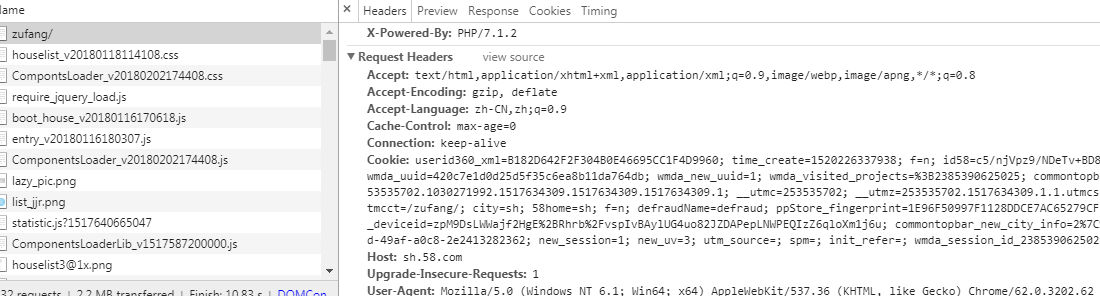

其中Request Headers的参数如下:

#headers的一些属性: #Accept:指定客户端能够接收的内容类型,内容类型的先后次序表示客户都接收的先后次序 #Accept-Lanuage:指定HTTP客户端浏览器用来展示返回信息优先选择的语言 #Accept-Encoding指定客户端浏览器可以支持的web服务器返回内容压缩编码类型。表示允许服务器在将输出内容发送到客户端以前进行压缩,以节约带宽。而这里设置的就是客户端浏览器所能够支持的返回压缩格式。 #Accept-Charset:HTTP客户端浏览器可以接受的字符编码集 # User-Agent : 有些服务器或 Proxy 会通过该值来判断是否是浏览器发出的请求 # Content-Type : 在使用 REST 接口时,服务器会检查该值,用来确定 HTTP Body 中的内容该怎样解析。 # application/xml : 在 XML RPC,如 RESTful/SOAP 调用时使用 # application/json : 在 JSON RPC 调用时使用 # application/x-www-form-urlencoded : 浏览器提交 Web 表单时使用 # 在使用服务器提供的 RESTful 或 SOAP 服务时, Content-Type 设置错误会导致服务器拒绝服务

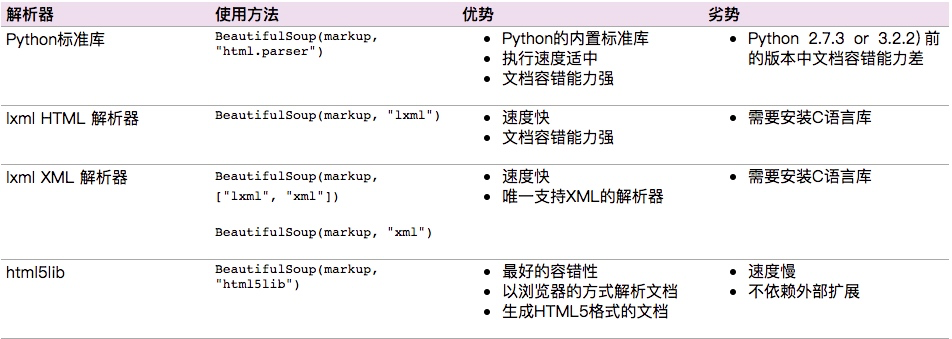

BeautifulSoup库

BeautifulSoup可以轻松的解析Requests库请求的页面,并把页面源代码解析为Soup文档,一边过滤提取数据。这是bs4.2的文档。

Beautiful Soup支持Python标准库中的HTML解析器,还支持一些第三方的解析器,如果我们不安装它,则 Python 会使用 Python默认的解析器,其中lxml 据说是相对而言比较强大的我下面的暗示是python 标准库的。

选择器select

# 选择所有div标签

soup.select("div")

# 选择所有p标签中的第三个标签

soup.select("p:nth-of-type(3)")

相当于soup.select(p)[2]

# 选择div标签下的所有img标签

soup.select("div img")

# 选择div标签下的直接a子标签

soup.select("div > a")

# 选择id=link1后的所有兄弟节点标签

soup.select("#link1 ~ .mybro")

# 选择id=link1后的下一个兄弟节点标签

soup.select("#link1 + .mybro")

# 选择a标签,其类属性为className的标签

soup.select("a .className")

# 选择a标签,其id属性为idName的标签

soup.select("a #idName")

# 选择a标签,其属性中存在attrName的所有标签

soup.select("a[attrName]")

# 选择a标签,其属性href=http://wangyanling.com的所有标签

soup.select("a[href='http://wangyanling.com']")

# 选择a标签,其href属性以http开头

soup.select('a[href^="http"]')

# 选择a标签,其href属性以lacie结尾

soup.select('a[href$="lacie"]')

# 选择a标签,其href属性包含.com

soup.select('a[href*=".com"]')

# 从html中排除某标签,此时soup中不再有script标签

[s.extract() for s in soup('script')]

# 如果想排除多个呢

[s.extract() for s in soup(['script','fram']BeautifulSoup库需要学习的知识点,请参考bs4.2的文档。在这不再过多叙述。

import requests

from bs4 import BeautifulSoup

header={'User-Agent':'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 Safari/537.36'}

res=requests.get('http://cd.58.com/zufang/',headers=header)

soup=BeautifulSoup(res.text,'html.parser')

print(soup.prettify())案例:爬取上海租房图片

import requests

import urllib.request

import os

import time

from bs4 import BeautifulSoup

header={'User-Agent':'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/62.0.3202.62 Safari/537.36'}

url=['http://sh.58.com/zufang/pn{}/?ClickID=2'.format(number) for number in range(6,51)]#分页抓取

adminCout=6

for arurl in url:

adminCout=adminCout+1

res=requests.get(arurl,headers=header)

soup=BeautifulSoup(res.text,'html.parser')

arryImg=soup.select('.img_list img')

print(arryImg)

count = 0;

for img in arryImg:

print(img['lazy_src'])

_url = img['lazy_src']

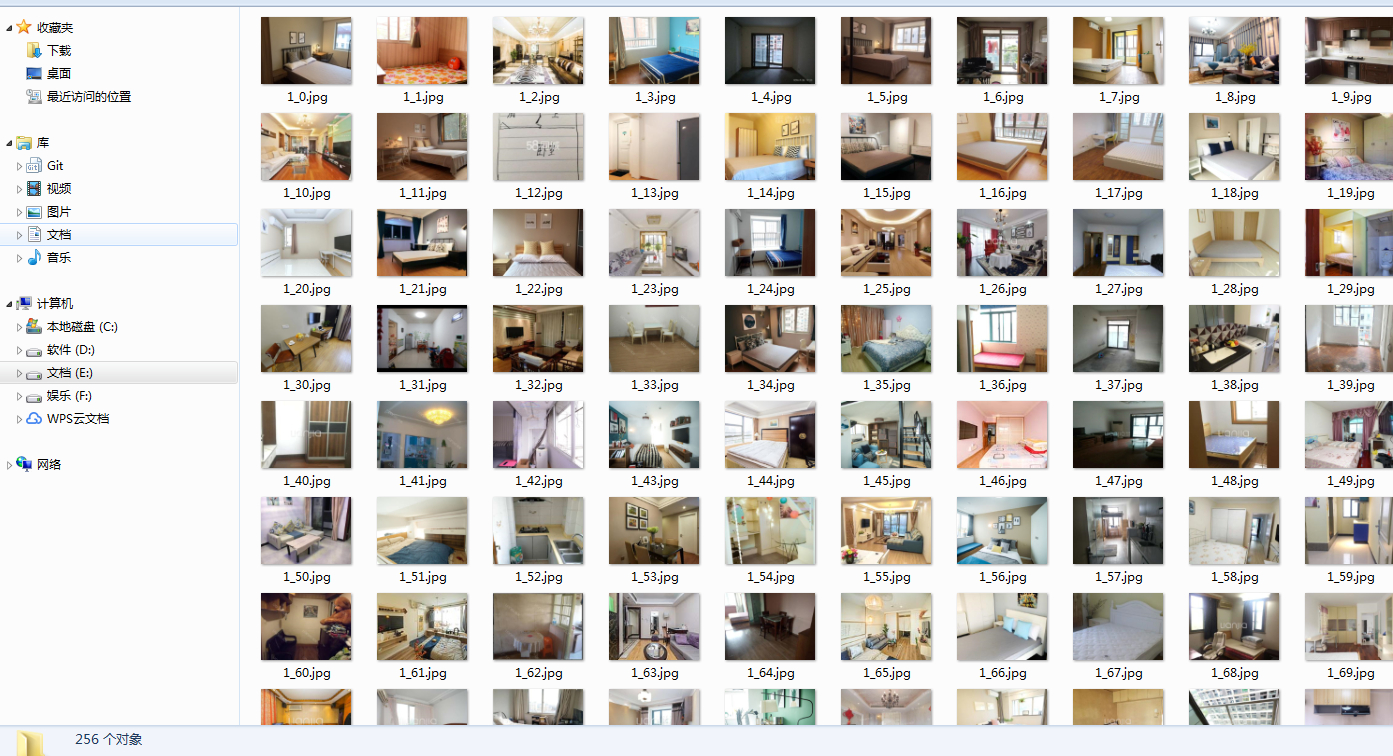

pathName = "E:\\2333\\" + str(adminCout)+"_"+str(count) + ".jpg" # 设置路径和文件名

result = urllib.request.urlopen(_url) # 打开链接,和python2.x不同请注意了

data = result.read() # 否则开始下载到本地

with open(pathName, "wb") as code:

code.write(data)

code.close()

count = count + 1 # 计数+1

print("正在下载第:", count)

time.sleep(30)只是实现功能,至于代码结果如下:

以上是“python如何爬取某站上海租房图片”这篇文章的所有内容,感谢各位的阅读!相信大家都有了一定的了解,希望分享的内容对大家有所帮助,如果还想学习更多知识,欢迎关注亿速云行业资讯频道!

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。