本文小编为大家详细介绍“Extracting, transforming和selecting features的使用方法是什么”,内容详细,步骤清晰,细节处理妥当,希望这篇“Extracting, transforming和selecting features的使用方法是什么”文章能帮助大家解决疑惑,下面跟着小编的思路慢慢深入,一起来学习新知识吧。

Table of Contents

Feature Extractors 特征提取

TF-IDF

Word2Vec

CountVectorizer

Feature Transformers 特征变换

Tokenizer 分词器

StopWordsRemover 停用字清除

nn-gram

Binarizer 二元化方法

PCA 主成成分分析

PolynomialExpansion 多项式扩展

Discrete Cosine Transform (DCT-离散余弦变换)

StringIndexer 字符串-索引变换

IndexToString 索引-字符串变换

OneHotEncoder 独热编码

VectorIndexer 向量类型索引化

Interaction

Normalizer 范数p-norm规范化

StandardScaler 标准化 基于特征矩阵的列,将属性值转换至服从正态分布

MinMaxScaler 最大-最小归一化[0,1]

MaxAbsScaler 绝对值归一化[-1,1]

Bucketizer 分箱器

ElementwiseProduct Hadamard乘积

SQLTransformer SQL变换

VectorAssembler 特征向量合并

QuantileDiscretizer 分位数离散化

Imputer

Feature Selectors 特征选择

VectorSlicer 向量选择

RFormula R模型公式

ChiSqSelector 卡方特征选择

Locality Sensitive Hashing 局部哈希敏感

Bucketed Random Projection for Euclidean Distance 欧式距离分桶随机投影

MinHash for Jaccard Distance 杰卡德距离

Feature Transformation 特征转换

Approximate Similarity Join 近似相似联接

Approximate Nearest Neighbor Search 近似最近邻搜索

LSH Operations

LSH Algorithms

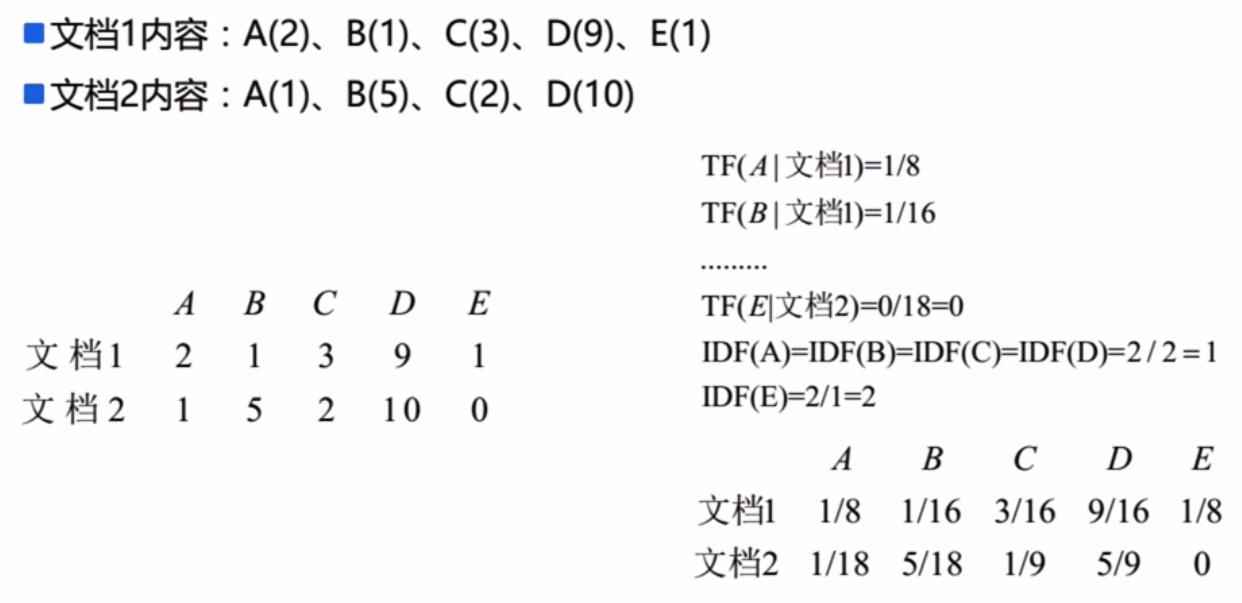

词频-逆向文件频率(TF-IDF)是一种特征向量化方法,广泛用于文本挖掘中,以反映词语对语料库中文档的重要性。 用tt表示词语,用dd表示文档,用DD表示语料库。 词语频率TF(t,d)TF(t,d)是词语tt在文档dd中出现的次数,而文档频率DF(t,D)DF(t,D)是包含词语的文档数量 tt。 如果我们仅使用词语频率来衡量重要性,则很容易过分强调那些经常出现但几乎没有有关文档信息的词语,e.g. “a”, “the”, and “of”。 如果一个词语在整个语料库中经常出现,则表示该词语不包含有关特定文档的重要信息。 反向文档频率是一个词语提供多少信息的数字度量:

IDF(t,D)=log|D|+1DF(t,D)+1,

D

是语料库中文档的总数。由于使用了log函数,如果某个词语出现在所有文档中,则其IDF值将变为0。加1是为了避免分母为0的情况。TF-IDF 度量值表示如下:

TFIDF(t,d,D)=TF(t,d)⋅IDF(t,D).

在 MLlib ,TF-IDF被分成两部分:TF 和 IDF,这样会更灵活。

TF: HashingTF和CountVectorizer都可以用来生成词语频率向量。.

HashingTF是一个转换器,它接受词条并将这些术语集转换为固定长度的特征向量。在文本处理中,一个词袋模型。HashingTF utilizes the hashing trick.原始特征使用hash 函数映射成为索引。这里hash函数是MurmurHash 3。然后根据映射的索引计算词频。这种方法避免了需要计算一个全局 term-to-index 地图,在映射大量语料库时需要花费更长的时间。但是存在的哈希冲突,即哈希后,不同的原始特征可能会是同一个词。为了减少碰撞的机会,我们可以增加特征维度,i.e., 提高hash表的桶数。由于使用了简单的模将哈希函数转换为列索引,建议使用2的幂作为特征维,否则,要素将不会均匀地映射到列。默认的特征维度是218=262,144218=262,144。可选的binary toggle parameter控制项频率计数。设置为true时,所有非零频率计数都设置为1。这对于模拟二进制计数而非整数计数的离散概率模型特别有用。

将文本文档转换为词语计数的向量。 有关更多详细信息,请参考 CountVectorizer。.

IDF: IDF是一个Estimator,在一个数据集上应用它的fit()方法,产生一个IDFModel。 该IDFModel 接收特征向量(由HashingTF产生),然后计算每一个词在文档中出现的频次。IDF会减少那些在语料库中出现频率较高的词的权重。

Note: spark.ml没有提供文本分割工具。 We refer users to the Stanford NLP Group and scalanlp/chalk.

读到这里,这篇“Extracting, transforming和selecting features的使用方法是什么”文章已经介绍完毕,想要掌握这篇文章的知识点还需要大家自己动手实践使用过才能领会,如果想了解更多相关内容的文章,欢迎关注亿速云行业资讯频道。

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

原文链接:https://my.oschina.net/u/3209854/blog/4953373