这篇文章给大家介绍基于Spark训练线性回归模型的实战入门是怎样的,内容非常详细,感兴趣的小伙伴们可以参考借鉴,希望对大家能有所帮助。

最开始接触分布式计算框架的是Hadoop中的MapReduce,虽然开发起来很复杂(Map与Reduce都要有相应的实现类)但是我也成功的启动了第一个“Hello word”(word count)。

由于MapReduce每个步骤都要将中间结果存到磁盘中,而且会将job jar 包分发到每个相关的Datanode上,虽然我的Txt文件不到1M, 但是启动计算加上返回结果的时间大概也有40秒左右,还能忍,毕竟是怀揣着我将要处理TB级别数据的梦想。

Spark作为分布式计算框架,采用的是一种基于内存的计算,减少了反复读取磁盘的数次,另外还提供了除了map与reduce更多的操作。这无疑是提供了最好的MapReduce替代品。然而最吸引我的不是spark的mapreduce有多么的快,而是spark集成了Machine Learning packages。

下面提供了一种接近实际生产环境,在Spark集群环境中,训练机器学习模型的完整方法

此项目教程主要特点:

文档齐全,代码简洁,教程操作性强,带有一步一步讲解

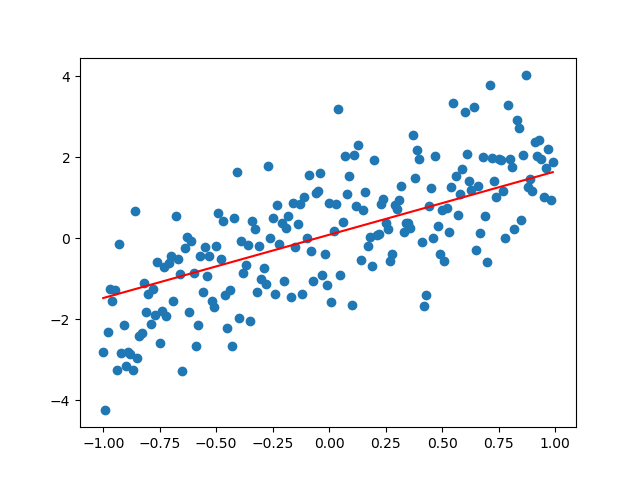

spark体验线性回归模型,属于最好的入门实战例子教程,初学者入门的不二之选

共分解为10个步骤,通俗易懂,操作性强:

关于基于Spark训练线性回归模型的实战入门是怎样的就分享到这里了,希望以上内容可以对大家有一定的帮助,可以学到更多知识。如果觉得文章不错,可以把它分享出去让更多的人看到。

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。