这篇文章主要介绍了如何用Python爬取指定关键词,具有一定借鉴价值,感兴趣的朋友可以参考下,希望大家阅读完这篇文章之后大有收获,下面让小编带着大家一起了解一下。

我们此次选择的是从移动端来对微博进行爬取。移动端的反爬就是信息校验反爬虫的cookie反爬虫,所以我们首先要登陆获取cookie。

登陆过后我们就可以获取到自己的cookie了,有不懂的小伙伴可以看这篇文章学会Cookie,解决登录爬取的困扰!。然后我们来观察用户是如何搜索微博内容的。

平时我们都是在这个地方输入关键字,来进行搜索微博。

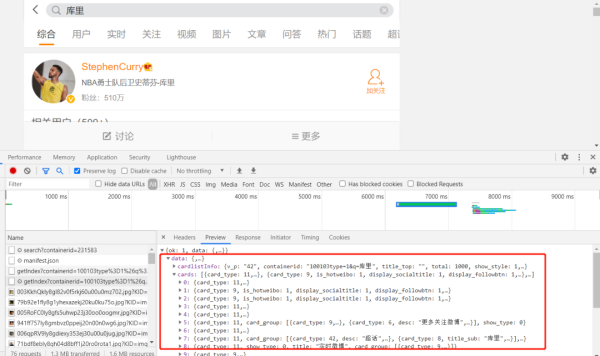

我通过在开发者模式下对这个页面观察发现,它每次对关键字发起请求后,就会返回一个XHR响应。

我们现在已经找到数据真实存在的页面了,那就可以进行爬虫的常规操作了。

在上面我们已经找到了数据存储的真实网页,现在我们只需对该网页发起请求,然后提取数据即可。

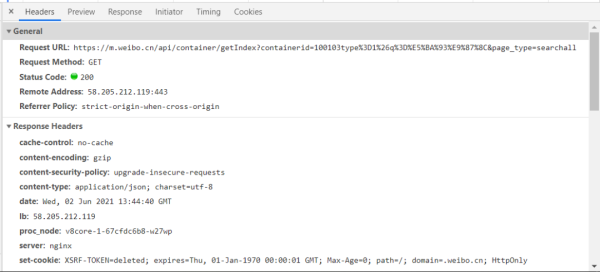

01发起请求

通过对请求头进行观察,我们不难构造出请求代码。

代码如下:

key = input("请输入爬取关键字:") for page in range(1,10): params = ( ('containerid', f'100103type=1&q={key}'), ('page_type', 'searchall'), ('page', str(page)), ) response = requests.get('https://m.weibo.cn/api/container/getIndex', headers=headers, params=params)02提取数据

从上面我们观察发现这个数据可以转化成字典来进行爬取,但是经过我实际测试发现,用正则来提取是最为简单方便的,所以这里展示的是正则提取的方式,有兴趣的读者可以尝试用字典方式来提取数据。代码如下:

r = response.text title = re.findall('"page_title":"(.*?)"',r) comments_count = re.findall('"comments_count":(.*?),',r) attitudes_count = re.findall('"attitudes_count":(.*?),',r) for i in range(len(title)): print(eval(f"'{title[i]}'"),comments_count[i],attitudes_count[i])在这里有一个小问题要注意,微博的标题是用Unicode编码的,如果直接爬取存储,将存储的是Unicode编码,在这里要感谢大佬—小明哥的帮助,志斌在网上搜了好多解决方法都没有成功,最后小明哥一个简单的函数就给解决了,实在是佩服!

解决方案:用eval()来输出标题,就可以将Unicode转换成汉字了。

感谢你能够认真阅读完这篇文章,希望小编分享的“如何用Python爬取指定关键词”这篇文章对大家有帮助,同时也希望大家多多支持亿速云,关注亿速云行业资讯频道,更多相关知识等着你来学习!

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。