怎么在python中利用多进程提取处理大量文本的关键词?针对这个问题,这篇文章详细介绍了相对应的分析和解答,希望可以帮助更多想解决这个问题的小伙伴找到更简单易行的方法。

代码如下:

#coding:utf-8

import sys

reload(sys)

sys.setdefaultencoding("utf-8")

from multiprocessing import Pool,Queue,Process

import multiprocessing as mp

import time,random

import os

import codecs

import jieba.analyse

jieba.analyse.set_stop_words("yy_stop_words.txt")

def extract_keyword(input_string):

#print("Do task by process {proc}".format(proc=os.getpid()))

tags = jieba.analyse.extract_tags(input_string, topK=100)

#print("key words:{kw}".format(kw=" ".join(tags)))

return tags

#def parallel_extract_keyword(input_string,out_file):

def parallel_extract_keyword(input_string):

#print("Do task by process {proc}".format(proc=os.getpid()))

tags = jieba.analyse.extract_tags(input_string, topK=100)

#time.sleep(random.random())

#print("key words:{kw}".format(kw=" ".join(tags)))

#o_f = open(out_file,'w')

#o_f.write(" ".join(tags)+"\n")

return tags

if __name__ == "__main__":

data_file = sys.argv[1]

with codecs.open(data_file) as f:

lines = f.readlines()

f.close()

out_put = data_file.split('.')[0] +"_tags.txt"

t0 = time.time()

for line in lines:

parallel_extract_keyword(line)

#parallel_extract_keyword(line,out_put)

#extract_keyword(line)

print("串行处理花费时间{t}".format(t=time.time()-t0))

pool = Pool(processes=int(mp.cpu_count()*0.7))

t1 = time.time()

#for line in lines:

#pool.apply_async(parallel_extract_keyword,(line,out_put))

#保存处理的结果,可以方便输出到文件

res = pool.map(parallel_extract_keyword,lines)

#print("Print keywords:")

#for tag in res:

#print(" ".join(tag))

pool.close()

pool.join()

print("并行处理花费时间{t}s".format(t=time.time()-t1))运行:

python data_process_by_multiprocess.py message.txt

message.txt是每行是一个文档,共581行,7M的数据

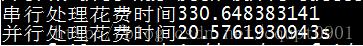

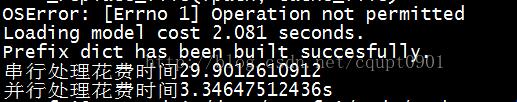

运行时间:

不使用sleep来挂起进程,也就是把time.sleep(random.random())注释掉,运行可以大大节省时间。

Python是一种跨平台的、具有解释性、编译性、互动性和面向对象的脚本语言,其最初的设计是用于编写自动化脚本,随着版本的不断更新和新功能的添加,常用于用于开发独立的项目和大型项目。

关于怎么在python中利用多进程提取处理大量文本的关键词问题的解答就分享到这里了,希望以上内容可以对大家有一定的帮助,如果你还有很多疑惑没有解开,可以关注亿速云行业资讯频道了解更多相关知识。

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。