这篇文章给大家分享的是有关如何使用python爬取千万条基金数据的内容。小编觉得挺实用的,因此分享给大家做个参考,一起跟随小编过来看看吧。

爬取基金的数据有个必要条件就是要知道基金代码,如何获取呢,打开官网找吧。

点了一圈,发现了基金代码的主页,寻思翻页爬取就完事了

http://fund.eastmoney.com/allfund.html

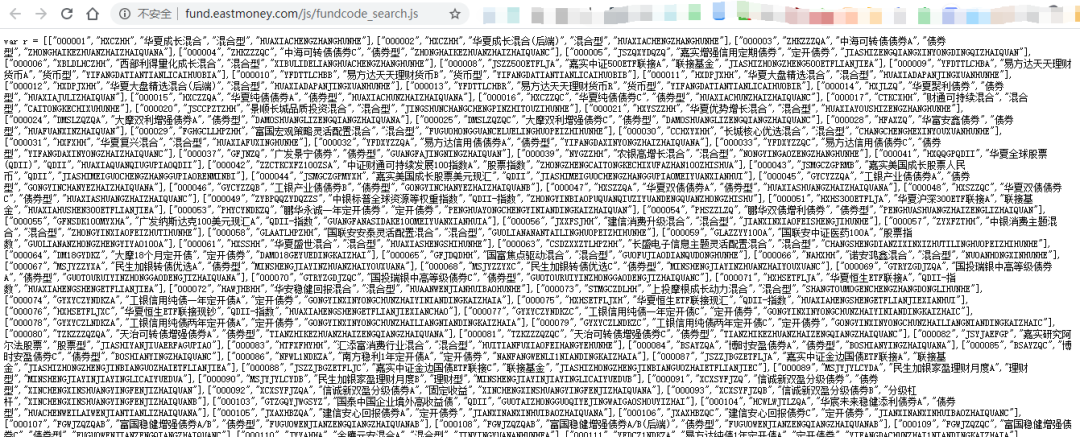

结果没想到F12打开下图中的fundcode_search.js

右键新标签页打开→

发现所有的基金代码都在,那么就更简单了呀。

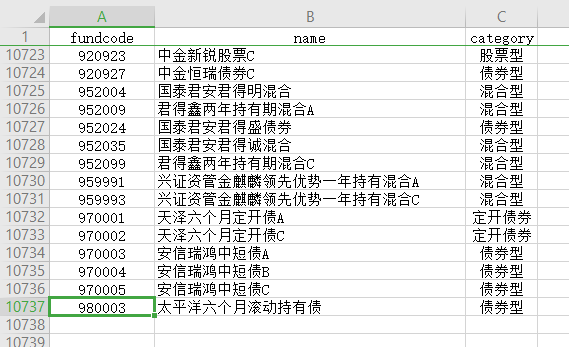

import requestsimport reimport jsonimport pandas as pdurl = 'http://fund.eastmoney.com/js/fundcode_search.js'r = requests.get(url)a = re.findall('var r = (.*])', r.text)[0] b = json.loads(a)fundcode = pd.DataFrame(b, columns=['fundcode', 'fundsx', 'name', 'category', 'fundpy']) fundcode = fundcode.loc[:, ['fundcode', 'name', 'category']]fundcode.to_csv('fundcode_search.csv', index=False, encoding='utf-8-sig')

运行获得所有基金代码共10736条数据。

有了上万个基金代码,再爬取他们近三年的净值数据,那四舍五入不就是千万条数据嘞~

之前就已经给出了方法,同样打开基金网站,用浏览器自带流量分析工具可以轻松找到数据接口。

其中callback为返回js回调函数,可以删除,funCode为基金代码,pageIndex为页码,pageSize为每页返回的数据条数是,startDate和endDate分别为开始时间和结束时间。[1]

fundCode = '001618' #基金代码pageIndex = 1startDate = '2018-02-22' #起始时间endDate = '2020-07-10' #截止时间header = { 'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64; rv:69.0) Gecko/20100101 Firefox/69.0', 'Referer': 'http://fundf10.eastmoney.com/jjjz_{0}.html'.format(fundCode)}url = 'http://api.fund.eastmoney.com/f10/lsjz?fundCode={0}&pageIndex={1}&pageSize=5000&startDate={2}&endDate={3}&_=1555586870418?'\ .format(fundCode, pageIndex, startDate, endDate)response = requests.get(url, headers=header)感谢各位的阅读!关于“如何使用python爬取千万条基金数据”这篇文章就分享到这里了,希望以上内容可以对大家有一定的帮助,让大家可以学到更多知识,如果觉得文章不错,可以把它分享出去让更多的人看到吧!

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

原文链接:https://my.oschina.net/u/4246997/blog/4435225