本文小编为大家详细介绍“pytorch如何使用nn.Moudle实现逻辑回归”,内容详细,步骤清晰,细节处理妥当,希望这篇“pytorch如何使用nn.Moudle实现逻辑回归”文章能帮助大家解决疑惑,下面跟着小编的思路慢慢深入,一起来学习新知识吧。

loss下降不明显

#源代码 out的数据接收方式

if torch.cuda.is_available():

x_data=Variable(x).cuda()

y_data=Variable(y).cuda()

else:

x_data=Variable(x)

y_data=Variable(y)

out=logistic_model(x_data) #根据逻辑回归模型拟合出的y值

loss=criterion(out.squeeze(),y_data) #计算损失函数#源代码 out的数据有拼装数据直接输入

# if torch.cuda.is_available():

# x_data=Variable(x).cuda()

# y_data=Variable(y).cuda()

# else:

# x_data=Variable(x)

# y_data=Variable(y)

out=logistic_model(x_data) #根据逻辑回归模型拟合出的y值

loss=criterion(out.squeeze(),y_data) #计算损失函数

print_loss=loss.data.item() #得出损失函数值import torch

from torch import nn

from torch.autograd import Variable

import matplotlib.pyplot as plt

import numpy as np

#生成数据

sample_nums = 100

mean_value = 1.7

bias = 1

n_data = torch.ones(sample_nums, 2)

x0 = torch.normal(mean_value * n_data, 1) + bias # 类别0 数据 shape=(100, 2)

y0 = torch.zeros(sample_nums) # 类别0 标签 shape=(100, 1)

x1 = torch.normal(-mean_value * n_data, 1) + bias # 类别1 数据 shape=(100, 2)

y1 = torch.ones(sample_nums) # 类别1 标签 shape=(100, 1)

x_data = torch.cat((x0, x1), 0) #按维数0行拼接

y_data = torch.cat((y0, y1), 0)

#画图

plt.scatter(x.data.numpy()[:, 0], x.data.numpy()[:, 1], c=y.data.numpy(), s=100, lw=0, cmap='RdYlGn')

plt.show()

# 利用torch.nn实现逻辑回归

class LogisticRegression(nn.Module):

def __init__(self):

super(LogisticRegression, self).__init__()

self.lr = nn.Linear(2, 1)

self.sm = nn.Sigmoid()

def forward(self, x):

x = self.lr(x)

x = self.sm(x)

return x

logistic_model = LogisticRegression()

# if torch.cuda.is_available():

# logistic_model.cuda()

#loss函数和优化

criterion = nn.BCELoss()

optimizer = torch.optim.SGD(logistic_model.parameters(), lr=0.01, momentum=0.9)

#开始训练

#训练10000次

for epoch in range(10000):

# if torch.cuda.is_available():

# x_data=Variable(x).cuda()

# y_data=Variable(y).cuda()

# else:

# x_data=Variable(x)

# y_data=Variable(y)

out=logistic_model(x_data) #根据逻辑回归模型拟合出的y值

loss=criterion(out.squeeze(),y_data) #计算损失函数

print_loss=loss.data.item() #得出损失函数值

#反向传播

loss.backward()

optimizer.step()

optimizer.zero_grad()

mask=out.ge(0.5).float() #以0.5为阈值进行分类

correct=(mask==y_data).sum().squeeze() #计算正确预测的样本个数

acc=correct.item()/x_data.size(0) #计算精度

#每隔20轮打印一下当前的误差和精度

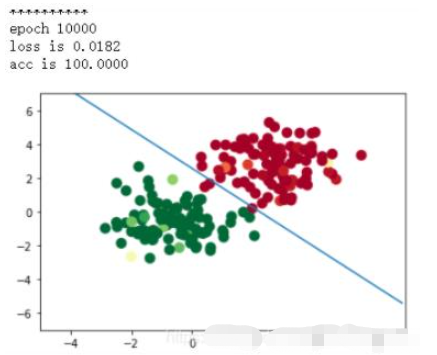

if (epoch+1)%100==0:

print('*'*10)

print('epoch {}'.format(epoch+1)) #误差

print('loss is {:.4f}'.format(print_loss))

print('acc is {:.4f}'.format(acc)) #精度

w0, w1 = logistic_model.lr.weight[0]

w0 = float(w0.item())

w1 = float(w1.item())

b = float(logistic_model.lr.bias.item())

plot_x = np.arange(-7, 7, 0.1)

plot_y = (-w0 * plot_x - b) / w1

plt.xlim(-5, 7)

plt.ylim(-7, 7)

plt.scatter(x.data.numpy()[:, 0], x.data.numpy()[:, 1], c=logistic_model(x_data)[:,0].cpu().data.numpy(), s=100, lw=0, cmap='RdYlGn')

plt.plot(plot_x, plot_y)

plt.show()

读到这里,这篇“pytorch如何使用nn.Moudle实现逻辑回归”文章已经介绍完毕,想要掌握这篇文章的知识点还需要大家自己动手实践使用过才能领会,如果想了解更多相关内容的文章,欢迎关注亿速云行业资讯频道。

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。