这篇文章给大家分享的是有关pytorch怎样实现线性回归的内容。小编觉得挺实用的,因此分享给大家做个参考,一起跟随小编过来看看吧。

具体内容如下

# 随机初始化一个二维数据集,使用朋友torch训练一个回归模型

import numpy as np

import random

import matplotlib.pyplot as plt

x = np.arange(20)

y = np.array([5*x[i] + random.randint(1,20) for i in range(len(x))]) # random.randint(参数1,参数2)函数返回参数1和参数2之间的任意整数

print('-'*50)

# 打印数据集

print(x)

print(y)

import torch

x_train = torch.from_numpy(x).float()

y_train = torch.from_numpy(y).float()

# model

class LinearRegression(torch.nn.Module):

def __init__(self):

super(LinearRegression, self).__init__()

# 输入与输出都是一维的

self.linear = torch.nn.Linear(1,1)

def forward(self,x):

return self.linear(x)

# 新建模型,误差函数,优化器

model = LinearRegression()

criterion = torch.nn.MSELoss()

optimizer = torch.optim.SGD(model.parameters(),0.001)

# 开始训练

num_epoch = 20

for i in range(num_epoch):

input_data = x_train.unsqueeze(1)

target = y_train.unsqueeze(1) # unsqueeze(1)在第二维增加一个维度

out = model(input_data)

loss = criterion(out,target)

optimizer.zero_grad()

loss.backward()

optimizer.step()

print("Eopch:[{}/{},loss:[{:.4f}]".format(i+1,num_epoch,loss.item()))

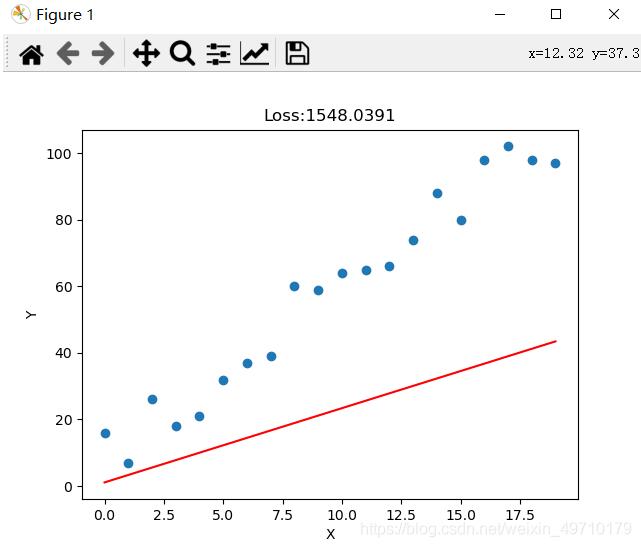

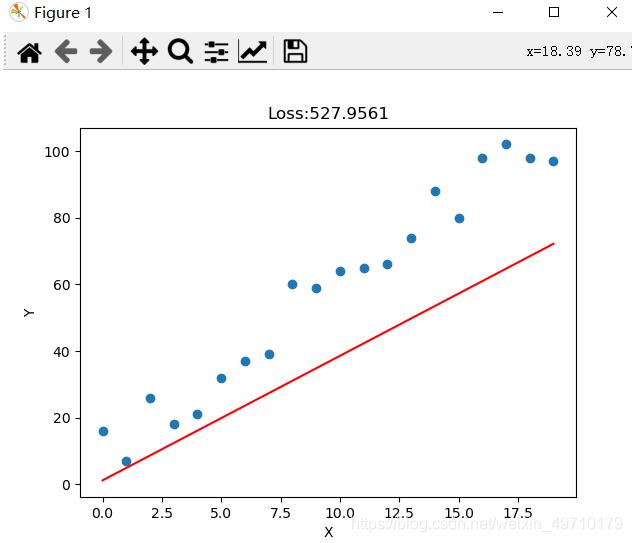

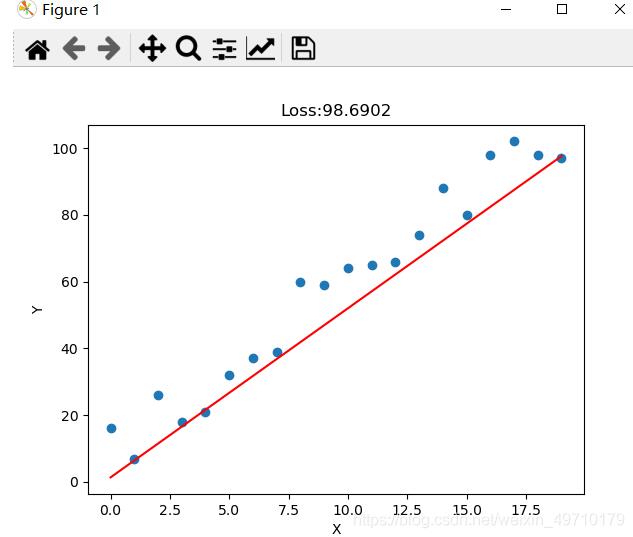

if ((i+1)%2 == 0):

predict = model(input_data)

plt.plot(x_train.data.numpy(),predict.squeeze(1).data.numpy(),"r")

loss = criterion(predict,target)

plt.title("Loss:{:.4f}".format(loss.item()))

plt.xlabel("X")

plt.ylabel("Y")

plt.scatter(x_train,y_train)

plt.show()实验结果:

感谢各位的阅读!关于“pytorch怎样实现线性回归”这篇文章就分享到这里了,希望以上内容可以对大家有一定的帮助,让大家可以学到更多知识,如果觉得文章不错,可以把它分享出去让更多的人看到吧!

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。