今天小编给大家分享一下Python爬虫框架NewSpaper如何使用的相关知识点,内容详细,逻辑清晰,相信大部分人都还太了解这方面的知识,所以分享这篇文章给大家参考一下,希望大家阅读完这篇文章后有所收获,下面我们一起来了解一下吧。

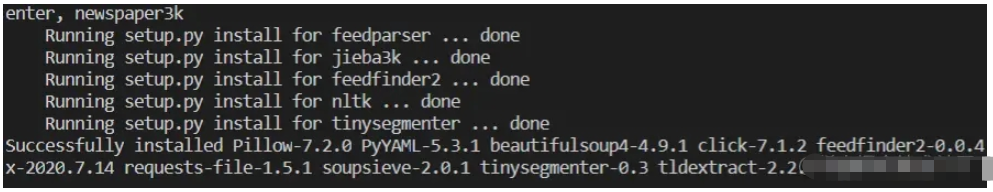

安装非常简单

pip install newspaper3k -i pypi.tuna.tsinghua.edu.cn/simple

对于这款框架,使用起来难度是非常低的。简单对照这一页文档即可应用起来

第一种应用方式,直接获取网页内容

from newspaper import Article url = "https://36kr.com/p/857678806293124" article = Article(url) # 创建文章对象 article.download() # 加载网页 article.parse() # 解析网页 print(article.html) # 打印html文档

当然还有一些其他属性,不过该框架都是基于关键字识别的,有一些BUG存在,有时识别不准

# print(article.html) # 打印html文档

print(article.text) # 新闻正文

print("-"*100)

print(article.title) # 新闻标题

print("-"*100)

print(article.authors) # 新闻作者

print("-"*100)

print(article.summary) # 新闻摘要

print(article.keywords) # 新闻关键词

# print(article.top_image) # 本文的top_image的URL

# print(article.images) # 本文中的所有图像url默认情况下,newspaper缓存所有待提取的文章,如果文章被爬取过之后就会清除掉它。此功能用于防止重复的文章和提高提取速度。可以使用memoize_articles参数选择是否缓存。

但当我使用下面这个办法进行提取的时候,神奇的BUG出现了,怎么也得不到我想要的文章了。唉~看来框架完善之路还是要继续啊

import newspaper

url = "https://news.sina.com.cn/c/2020-08-29/doc-iivhvpwy3651884.shtml"

# article = Article(url) # 创建文章对象

# article.download() # 加载网页

# article.parse() # 解析网页

news = newspaper.build(url, language='zh', memoize_articles=False)

article = news.articles[0]

article.download()

article.parse()

print('title=',article.title)在应用的过程中发现确实解析存在很大的问题,不过整体的框架设计思路还是非常棒的。有点高开低走 ,看到github上的评语其实对newspaper是非常有期待的,使用之后,我建议还是使用requests然后加上bs4自己搞搞更加合理。

除了上面简单介绍到的功能,它还有一些扩展,例如下面这些

requests和newspaper合体解析网页正文,也就是用requests爬取,newspaper充当解析器

可以调用Google Trends信息

支持多任务爬取

支持NPL自然语言处理

以上就是“Python爬虫框架NewSpaper如何使用”这篇文章的所有内容,感谢各位的阅读!相信大家阅读完这篇文章都有很大的收获,小编每天都会为大家更新不同的知识,如果还想学习更多的知识,请关注亿速云行业资讯频道。

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。