这篇文章主要介绍了Python爬虫如何抓取多个URL写入本地文件的相关知识,内容详细易懂,操作简单快捷,具有一定借鉴价值,相信大家阅读完这篇Python爬虫如何抓取多个URL写入本地文件文章都会有所收获,下面我们一起来看看吧。

1. Pycharm中运行Scrapy

windows环境下cmd中通过scrapy startproject 项目名,创建scrapy项目

修改Run…中的Script path为cmdline.py文件路径F:\programs\python\Lib\site-packages\scrapy\cmdline.py

Parameters为crawl 爬虫文件名

working directory为scrapy项目所在文件夹

每次执行该run命令即可运行scrapy

2.items.py

class Csdn02Item(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

title = scrapy.Field()#标题

updatetime = scrapy.Field()#发表时间

readcount = scrapy.Field()#阅读数

author = scrapy.Field()#作者

ranking = scrapy.Field()#博客排名

curl = scrapy.Field()#博文链接

context = scrapy.Field()#博文内容

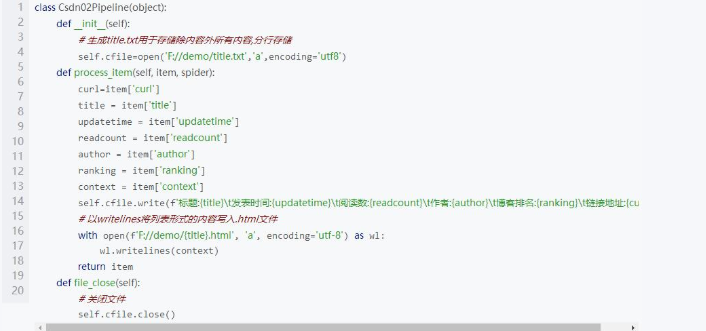

3.pipelines.py

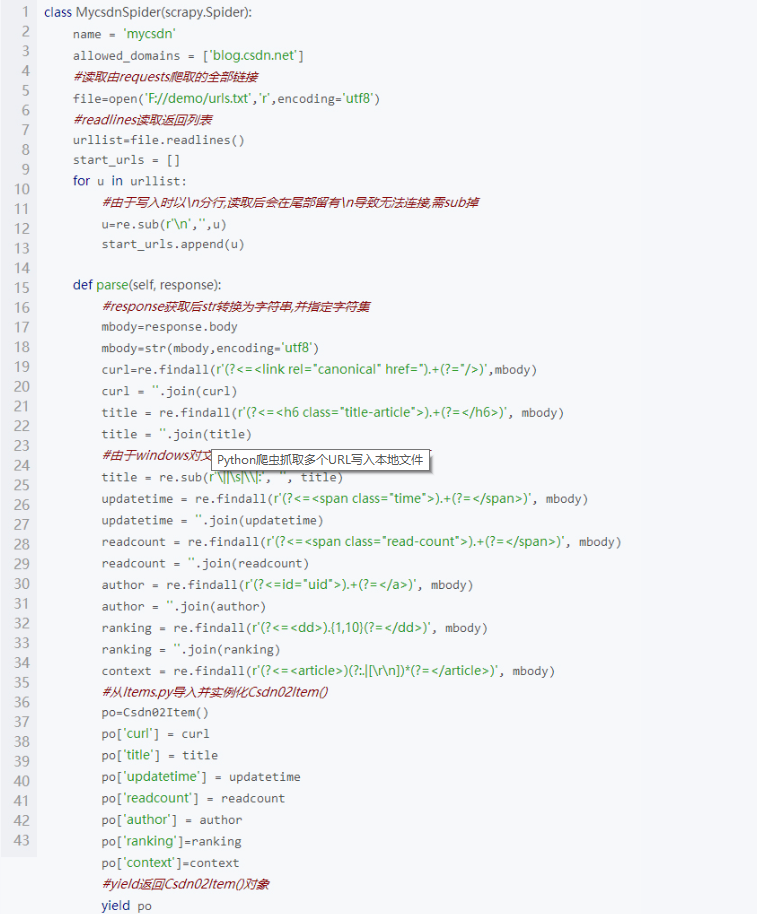

4.自定义的爬虫代码mycsdn.py

关于“Python爬虫如何抓取多个URL写入本地文件”这篇文章的内容就介绍到这里,感谢各位的阅读!相信大家对“Python爬虫如何抓取多个URL写入本地文件”知识都有一定的了解,大家如果还想学习更多知识,欢迎关注亿速云行业资讯频道。

亿速云「云服务器」,即开即用、新一代英特尔至强铂金CPU、三副本存储NVMe SSD云盘,价格低至29元/月。点击查看>>

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

原文链接:https://my.oschina.net/u/3711840/blog/4457450